AI, 옛 가수들을 부활시키다? 진짜 같은 가짜, 그 안에서 펼쳐지는 새로운 세상

글. 오혜진(과학 칼럼니스트)

-

스스로 말하는 법을 배운 AI

얼마 전 세상을 떠난 옛 가수들을 인공지능(AI) 기술로 재현하는 TV 프로그램이 방영되며 화제가 됐습니다. 이미 세상을 떠난 가수들의 목소리와 모습이 AI로 생생하게 복원돼 새로운 곡과 무대를 연출한 것. 이런 무대가 가능할 수 있었던 것은 AI의 음성 합성 기술과 영상 합성 기술의 발전 덕분입니다.

음성 합성 기술은 원하는 텍스트를 입력하면 사람의 목소리로 출력해주는 기술을 말합니다. 2017년 3월, 구글의 딥마인드가 AI 딥러닝 기술을 이용한 ‘타코트론’을 공개하면서 음성 합성 기술은 전환점을 맞았죠. 여러 단계를 거칠 필요 없이 원하는 텍스트와 짧은 음성 데이터만 있으면 음성 합성이 가능해진 것입니다. AI는 딥러닝을 통해 축적한 많은 양의 음성 데이터를 듣고 스스로 학습해 호흡과 높낮이, 강세 등 음성을 발음하는 방법을 터득합니다. 마치 아기가 옹알이를 하다가 다른 사람의 목소리를 들으면서 자연스럽게 말하는 법을 깨우치는 것과 비슷하죠. 여기에 원하는 화자의 데이터를 새롭게 추가해 적응 훈련을 하면 화자의 말투를 그대로 흉내 낸 목소리를 만들 수 있습니다. 2019년 엔씨소프트는 김영하 작가가 녹음한 10분 분량의 목소리만으로도 비슷한 음성을 합성하는 데 성공했습니다.

-

진짜 같은 가짜 딥페이크 기술

영상 합성 기술도 AI를 기반으로 진화하고 있는데 이를 ‘딥페이크(Deepfake)’라고 합니다. ‘딥러닝’과 ‘가짜(Fake)’의 합성어로, AI의 딥러닝 기술로 얼굴이나 표정, 몸짓 등 영상을 합성해 진짜 같은 가짜를 만들어내는 일종의 위조 기술이죠. 이 기술을 이용하면 기존 영상에 다른 인물을 빠르고 정교하게 합성할 수 있습니다.

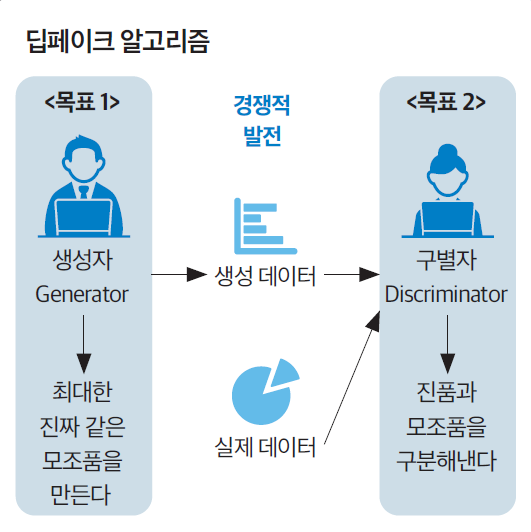

딥페이크 사진이나 동영상을 만들기 위해서는 AI에게 수백, 수천 개의 이미지를 학습시켜 특정 얼굴이나 패턴을 인식하는 훈련 과정을 거칩니다. 여기에는 ‘생성자’와 ‘감별자’라는 두 알고리즘이 사용되는데요, 생성자 알고리즘이 이미지를 만들면 감별자는 이 이미지가 가짜인지 진짜인지를 판별합니다. 그리고 이 과정을 계속 반복하면서 두 알고리즘이 서로 경쟁하듯 차이점을 분석하고 학습하면 점점 더 정교한 가짜 이미지를 만들어낼 수 있게 됩니다. 경찰이 진짜 지폐와 위조지폐를 구별해 범인을 잡으면 위조지폐범이 경찰의 눈을 속이기 위해 더욱 정교한 위조지폐를 만드는 방식과도 비슷합니다.

-

AI의 행보를 주목하라

앞으로 사람의 감성과 개성까지 표현하는 기술이 발전한다면 AI 음성 합성 기술과 영상 합성 기술은 무궁무진하게 활용될 수 있습니다. 고인의 모습을 복원하는 것에서부터 원하는 연예인이나 가족의 목소리로 책을 읽어주는 서비스, 안내 방송 등 맞춤형 음성•영상 서비스가 가능하고, 게임, 영화 등 각종 창작물이나 영상을 다양한 언어로 더빙하는 데도 쓰일 수 있습니다.

하지만 이 기술은 악의적으로 사용될 여지도 큽니다. 음성 합성 기술을 보이스 피싱에 이용하거나, 유명인의 얼굴을 사용해 음란물 혹은 가짜 뉴스 등을 감쪽같이 만들어 낼 수 있기 때문이죠. 이 때문에 전 세계에서 딥페이크 탐지 기술을 개발하고 있습니다. 첨단 기술의 발전과 함께 디지털 범죄에 대한 경각심을 가지고, 법과 제도 등을 적극적으로 마련하는 일이 시급한 이유가 여기에 있습니다.

'Story > 효성' 카테고리의 다른 글

| 우리 생활 속 빅데이터 돋보기: 데이터 속 무궁무진한 가능성 (0) | 2021.05.04 |

|---|---|

| 도시락 싸서 떠나는 서울 근교 언택트 봄나들이 장소 추천 (2) | 2021.05.03 |

| 세계 최강의 기업들 ④ 스위스의 태양광 비행기, 미래를 날다 (0) | 2021.04.29 |

| 효성그룹 뉴스레터 2021년 4월 2호 | 이 두근거림으로 (0) | 2021.04.28 |

| 환경을 생각하는 섬유 ‘리젠’을 만나다: 효성 신입사원의 구미공장 견학기 (0) | 2021.04.28 |